El mundo del SEO se encuentra en constante cambio, sobre todo lo que respecta a las modificaciones en los algoritmos de Google. Dichas actualizaciones, también conocidas como Google Core Update, producen un impacto significativo en las clasificaciones de la SERP de Google y sus resultados de búsqueda, afectando al tráfico orgánico de un sitio web.

Este artículo nace con la idea y necesidad que tuvimos al sufrir durante años las modificaciones que Google ejecuta sobre sus algoritmos. Este repaso histórico irá del primer al último Google Core Update, donde podrás observar cómo ha afectado el contenido y la experiencia del usuario.

¿Qué es el Google Core Update?

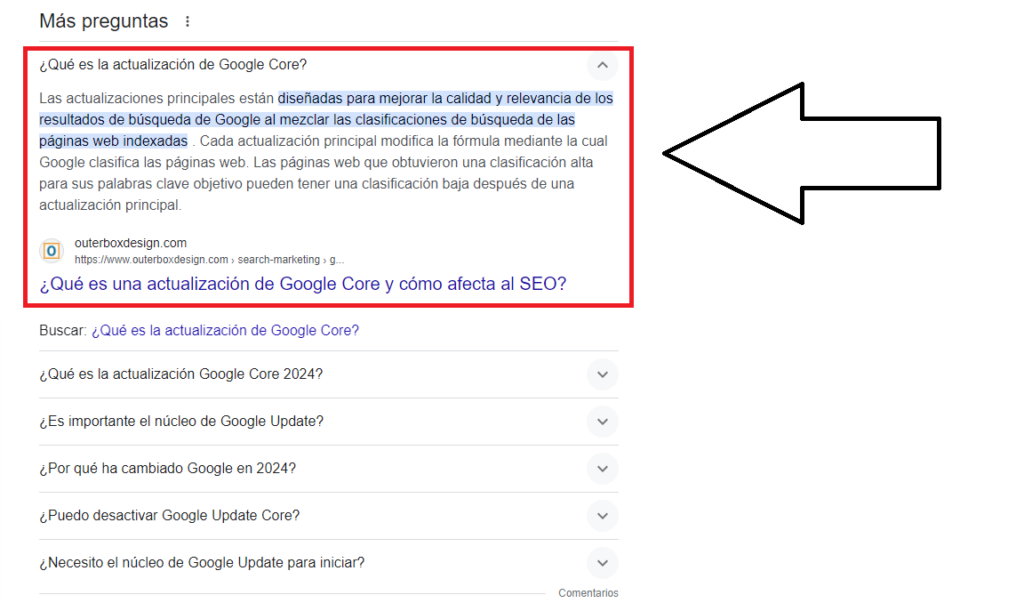

Un Google Core Update es una actualización relevante del algoritmo de búsqueda que ejecuta cada cierto tiempo Google. Estos cambios tienen como objetivo mejorar la relevancia y calidad de los resultados de búsqueda que se muestran a los usuarios, al reajustar los factores que determinan el posicionamiento de las páginas web en los resultados orgánicos que muestra el buscador.

Pero… ¿Por qué son importantes? Está claro que estas actualizaciones suponen un cambio en la manera que Google valora la información que ofrecen los sitios web y las clasifica. Esto suele afectar, para mal o para bien, los resultados y el tráfico orgánico existente, por lo que es necesario mantenerse actualizado y optimizar el contenido según las recomendaciones de Google para que el usuario pueda encontrar útil el sitio.

Puedes realizar un seguimiento en el panel de estado de búsqueda de Google, donde podrás visualizar no solo los últimos Core Update con su respectiva fecha, sino también los Spam Update.

Google Core Update marzo 2024

La última actualización del Google Core Update es la del 5 de marzo del 2024. Según se comenta, la misma ha supuesto cambios revolucionarios en el algoritmo de Google, reflejando una gran variedad de cambios, similar a lo que supuso el lanzamiento de Penguin en el lejano 2012.

Esta actualización no solo ha mejorado el núcleo del algoritmo de clasificación, sino que también ha introducido un nuevo sistema de clasificación que prioriza la confiabilidad del contenido publicado. ¿A qué se debe esto? Sencillo: la llegada de la IA (inteligencia artificial). El objetivo es elevar el contenido de calidad e integrarlo a los principales resultados.

Los componentes clave que forman parte de esta nueva actualización de Google son:

- Algoritmo de clasificación central: se trata de los ajustes fundamentales para priorizar aún más la calidad y relevancia del contenido en los resultados de búsqueda.

- Sistema de contenido útil: la integración de esta iniciativa permite que el algoritmo de clasificación destaque el contenido genuinamente útil y valioso para los usuarios.

- Nuevas políticas de spam y mejoras en spambrain: se trata de la introducción de políticas más estrictas contra diversas formas de spam, reforzadas por la IA de SpamBrain mejorada.

¿Qué impacto ha tenido esto en la comunidad SEO y el marketing digital en general? Lo cierto es que el mundo SEO ha resentido bastante estas modificaciones, ya que se ha comenzado a eliminar masivamente contenido de baja calidad en los resultados de búsqueda de Google. Esto destaca obviamente la necesidad e importancia de centrarse en la calidad y confiabilidad.

¿Cómo protegerte de estas actualizaciones?

La mejor manera de recuperarse y protegerse de esta actualización es seguir de cerca las directrices de Google y eliminar el contenido inútil que tenga cada sitio, ya que esto es considerado por los buscadores al momento de recomendar un sitio y asignarle una Authority Score (puntuación de autoridad). Este es un valor numérico que referencia la calidad general y SEO del sitio, demostrando autoridad y seguridad.

Otra gran recomendación es que seas capaz de evitar tácticas de spam, y enfocarte en el E-E-A-T, es decir, crear contenido de calidad que demuestre Excelencia, Experiencia, Autoridad y Confiabilidad.

Google Core Update noviembre 2023

El Google Core Update del 2 de noviembre de 2023 mantuvo en vilo a la comunidad del SEO al implementar ajustes significativos en el algoritmo de clasificación. En este punto, ya comenzaba a notarse la tendencia de Google por el contenido de calidad y que favorezca la experiencia de los usuarios para que los sitios se posicionen mejor.

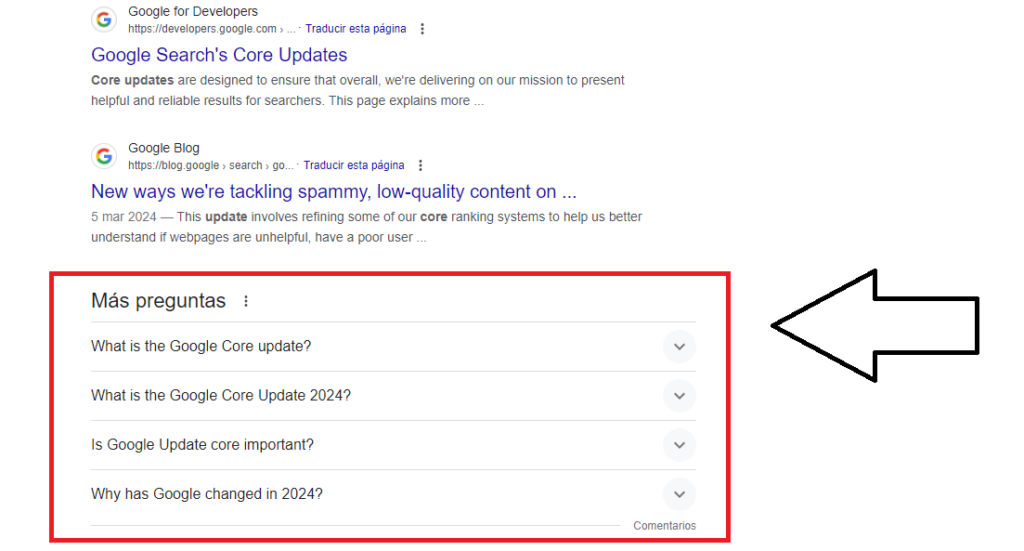

Así mismo, también vale la pena aclarar que los sitios con contenido Evergreen (atemporal, es decir, no son tendencias que aparecen y desaparecen) y añadir información directamente en sus resultados de búsqueda mediante PAA (people also ask en inglés), que son las preguntas frecuentes, también conocidas como “Más preguntas” u “Otras preguntas de los usuarios” en Google.

Beneficiados y perjudicados por el Core Update

Si bien no es del todo cierto confiar a ciertos sectores como “Beneficiados” o “Perjudicados” es real que muchos sitios pudieron evidenciar resultados ampliamente positivos desde la aplicación de estos cambios. El caso de Wikipedia y/o el de los diccionarios es el más destacado, ya que Google posicionó extractos de sus contenidos en los resultados de búsqueda que se veían en las PAA de la SERP.

En el caso de los sectores más afectados, no podemos dejar de mencionar a las páginas de medios y noticias que, por sobre todas las cosas, no se encuentran actualizadas. En el caso de que se encuentren actualizadas, entonces Google priorizará únicamente las que son más relevantes para el usuario.

Estos resultados, en las páginas de news, se deben en parte al factor QDF (Query Deserves Freshness). Se trata de un algoritmo de Google que ajusta las clasificaciones de búsqueda en función de la novedad del contenido requerido por una consulta de búsqueda. Cuando ocurre un evento inesperado o un tema es tendencia, Google da preferencia al contenido nuevo y oportuno en lugar de páginas más antiguas y posiblemente desactualizadas.

Google Core Update octubre 2023

El Google Core Update del 5 de octubre de 2023 se destacó por perfeccionar la experiencia de búsqueda para consultas relacionadas con compras. Google recalibró su algoritmo para resaltar la relevancia y utilidad del contenido en este contexto específico. El énfasis se puso en dos aspectos clave:

- Contenido útil y actualizado

- Precisión en la información proporcionada

Esto significa que los sitios web que ofrecen contenido valioso y relevante para los compradores tienen más probabilidades de destacarse en los resultados de búsqueda. La importancia de mantener el contenido actualizado y relevante para los visitantes se subrayó aún más, ya que la precisión y la actualización son factores clave para satisfacer las necesidades de los usuarios.

Google Core Update agosto 2023

Te presento el Google Core Update del 22 de agosto del 2023. Esta actualización ya comenzaba a sugerir los cambios en cuanto a la calidad y evaluación de los contenidos que tenían los sitios. Además, Google enfatizó en dos aspectos principales; la autoridad del dominio y la calidad de los enlaces. En lugar de simplemente valorar la reputación del sitio que proporciona el enlace, la actualización resalta la importancia de que el enlace brinde valor al usuario.

¿Esto significa que los enlaces lo son todo? Pues no, pero sí que importan. Los enlaces deben ampliar información, respaldar argumentos, simplificar conceptos o dirigir a los usuarios hacia productos, servicios o recursos pertinentes. La clave está en entender que la calidad del aporte que el enlace ofrece al usuario es más importante que la reputación del sitio que lo proporciona.

Este cambio refleja la evolución de Google hacia un enfoque más centrado en el usuario, donde la relevancia y la utilidad son los principales criterios para determinar la calidad de los resultados de búsqueda.

Google Core Update marzo 2023

Durante el Google Core Update del 15 de marzo de 2023, se observó un aumento significativo en la volatilidad de los rankings, marcando una desviación notable respecto a las actualizaciones anteriores. Este incremento tan notorio en la volatilidad pudo evidenciarse tanto en computadoras de escritorio como en dispositivos móviles, como tabletas o smartphones.

Además de lo comentado, vale la pena destacar que se detectaron puntuaciones más altas de volatilidad en los sectores de Compras y Artes & Entretenimiento.

Google Core Update septiembre 2022

La última actualización del año 2022 (12 de septiembre) impactó en las mismas áreas que el Google Helpful Content Update (Actualización de Contenido Útil). En este caso, se hizo énfasis en desfavorecer el contenido que:

- Fue hecho con IA (Inteligencia Artificial)

- Carece de valor único y para el usuario

- Esté hecho para cubrir las necesidades de los motores de búsqueda

Para impulsar esto, se enviaron cuestionarios para evaluar la fiabilidad y calidad del contenido, lo que ayudó a los editores a entender si estaban cumpliendo con las nuevas expectativas establecidas por la actualización.

Esta actualización no hizo más que profundizar el problema que dejó el Core Update de mayo, el cual tuvo como resultado la limpieza masiva de contenido por parte de propietarios de sitios web cuyo contenido era poco útil de cara a los usuarios.

Google Core Update mayo 2022

La actualización del 25 de mayo de 2022 afectó principalmente a los resultados de búsqueda, ya que se centró en mejorar la eficacia de las búsquedas hechas por los usuarios. Su principal enfoque fue el E-A-T (Experiencia, Autoridad y Confianza) de los contenidos. Los fragmentos enriquecidos que mostraba la SERP de Google, además de las preguntas frecuentes, pasaron a ganar más importancia, al igual que las imágenes y los videos.

Ahora, el objetivo era lograr que Google capte el contenido relevante de un artículo y lo coloque en las FAQs o bien en el fragmento destacado (featured snippet). En ese sentido, es totalmente posible afirmar que el contenido especializado comenzó a ganar terreno por sobre el generalista (mayormente hecho con IA), afectando negativamente a los sitios de comercio electrónico.

Google Core Update noviembre 2021

Vamos ahora al Google Core Update que tuvo lugar el 17 de noviembre del año 2021. Para este punto de la historia, y con una pandemia sobre todos nosotros, la comunidad SEO estaba muy atenta a los reportes que reflejaban Google Analytics y Search Console para evaluar el impacto en los sitios web.

SEMrush reportó que la actualización fue un 12% más inestable que la de julio, con un impacto mayor en dispositivos móviles que en equipos de escritorio (23% más). La industria de la salud experimentó un aumento del 41% en las fluctuaciones de resultados, y el 16% de las 20 URLs mejor clasificadas antes de la actualización vieron un deterioro en sus clasificaciones.

También se detectaron fluctuaciones en los sectores de salud, finanzas y viajes, pero no en ventas. Por ejemplo, los sitios más populares en ventas experimentaron cambios en sus primeras posiciones (top 10). Podríamos hablar de perdedores y ganadores, pero lo cierto es que estas caídas no son definitivas y los cambios se ven día a día, de modo que será cuestión de optimizar los sitios, pulir los contenidos y remover todo lo que no sea útil para el usuario.

Google Core Update julio 2021

El GCU que tuvo lugar el 1 de julio del 2021, fue hecho para mejorar la experiencia de los usuarios en el sitio, generando cambios y modificaciones que fueron advertidos por muchos especialistas SEO. Algunos de estos cambios incluyen:

- Variación en la posición de las palabras clave

- Pérdida de visibilidad del sitio web

- Posicionamiento fluctuante en los últimos días

- Disminución en las impresiones y clics

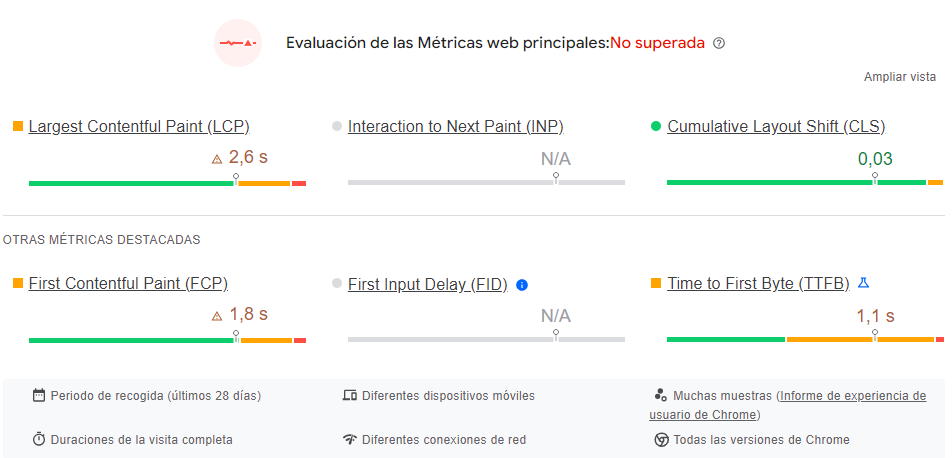

Pero… ¿Por qué ocurre esto? Básicamente, Google está priorizando las páginas que ofrecen contenido de calidad y temas relevantes Core Web Vitals, que incluyen el LCP (tiempo de carga del contenido más grande), el CLS (estabilidad visual de la página) y el FID (tiempo de respuesta del navegador tras la interacción del usuario). Estos factores benefician directamente la experiencia del usuario en un sitio web, lo que se refleja en su posicionamiento en los resultados de búsqueda.

Para que puedas acceder a estos datos, es tan sencillo como utilizar la herramienta de Google llamada PageSpeed Insights, que ahora cuenta con una función integrada en la extensión Lighthouse.

Google Core Update junio 2021

La actualización del Google Core Update del 28 de junio de 2021 trajo consigo cambios significativos en la visibilidad de los resultados de búsqueda. Por ejemplo, al buscar la palabra “correccional”, ahora se priorizan los resultados de referencia de Wikipedia y diccionarios en línea sobre otros contenidos, como “El centro correccional juvenil”, entre otros ejemplos.

Entre los principales factores a destacar de esta nueva actualización, vale la pena destacar:

- Experiencia del usuario: el algoritmo comenzó a priorizar las páginas que ofrecen una experiencia positiva y contenido único y de calidad. Es fundamental que las páginas sean funcionales, fiables y estén optimizadas para dispositivos móviles.

- Optimización para móviles: los sitios que se encuentran mejor optimizados para móviles obtienen mayores beneficios en cuanto a su posicionamiento, ya que un porcentaje muy alto de usuarios ingresan desde ese tipo de dispositivos.

- Navegación segura con HTTPS: comienza a ser totalmente obligatorio que los sitios web estén protegidos con certificados SSL “HTTPS” para garantizar la seguridad de los usuarios, puesto que Google puede optar por desindexar los sitios que no lo hagan o, en su defecto, afectar su tráfico y posicionamiento.

- Directrices sobre elementos externos que sean intrusivos: se recomienda evitar el uso de pop-ups intrusivos que puedan afectar la experiencia del usuario.

Google Core Update diciembre 2020

El día 3 de diciembre, Google lanzaba lo que era su último Core Update del 2020. En el mismo, se representó un cambio significativo en el algoritmo de búsqueda.

A diferencia de actualizaciones como Panda y Penguin, que se centraban en aspectos específicos como la calidad del contenido y los perfiles de enlaces, el Core Update afecta a todo el algoritmo de Google. Es una reescritura integral que influye en todos los aspectos del ranking de búsqueda.

¿Cuál es el problema en todo esto? De seguro te estarás preguntando… y lo cierto es que, teniendo en cuenta esto, es muy complejo determinar la verdadera razón por la cual un sitio web puede perder o ganar tráfico luego de un Core Update.

Google Core Update mayo 2020

El Google Core Update del 4 de mayo del 2020 introdujo muchos cambios en los resultados de búsqueda, los SEO pudieron observar la aparición de nuevos resultados que Google estaba priorizando aún más, como las imágenes, fragmentos enriquecidos y videos. Adicionalmente, se comenzó a notar un mayor énfasis en los resultados locales de cada país, siendo que Google volvió a centrarse en sitios de salud, finanzas y legales.

Se ha notado que algunos sitios han sido beneficiados con esto, como Pinterest y Amazon, obteniendo un incremento notorio de tráfico, mientras que los sitios de nicho han sido afectados.

Google Core Update enero 2020

¡Finalmente llegamos! La primera actualización de Google Core Update, realizada el 13 de enero del 2020. Al principio, los propietarios de los sitios pudieron notar las reacciones tempranas en los rankings de cada sitio web, como posicionaban sus palabras claves y demás.

Se observaron cambios en la aparición de nuevos módulos o tipos de resultados en las SERPs, como imágenes, fragmentos enriquecidos, módulos de video y módulos locales. Google incidió sobre páginas de tipo YMYL (Your Money or Your Life), como sitios de salud, finanzas y legal, con ajustes en actualizaciones anteriores para este tipo de sitios.

¿Cómo trabajar correctamente siguiendo los lineamientos de los Update de Google?

En conclusión, los Core Updates representan cambios significativos en el algoritmo de búsqueda de Google, con el objetivo de mejorar la calidad y relevancia de los resultados para los usuarios. ¿Suelen ser positivos? Bueno, esto dependerá de a qué dueño de cada sitio web le preguntes, ya que los impactos suelen variar en relación con cada web.

Honestamente, considero que Google no ofrece mucha información sobre la naturaleza específica de estas actualizaciones, más allá de la recomendación genérica de crear contenido de alta calidad que guste a los usuarios.

Lo que queda es ajustar el sitio lo máximo posible a lo solicitado por Google y enfocarlo en función a las necesidades del usuario. Por eso es que los profesionales del SEO y marketing digital deben de estar actualizados y alerta a los cambios que sean introducidos.

Si te centras en la calidad del contenido, la experiencia del usuario y el cumplimiento de las directrices de Google, podrás navegar con éxito por estos cambios y mantener la competitividad de tu sitio web.

¡En MD Marketing Digital lo tenemos claro!

Existen muchos sitios que pueden modificar sus contenidos y lograr resultados positivos, mientras que otros no han corrido con la misma suerte. ¡Para lograr resultados a la altura de tus expectativas, puedes contar con nuestra ayuda!

En MD Marketing Digital nos especializamos en SEO y diseño web acondicionado para cumplir con las necesidades del usuario, podemos brindarte asistencia para lograr que tu sitio y sus contenidos alcancen grandes cuotas de calidad.

¿Te interesa? ¡Contáctanos para comenzar a trabajar juntos!

- Google Spam Update: Historial de las actualizaciones principales de Google - julio 22, 2024

- Marketing para hoteles: guía completa para mejorar tu estrategia online [2024] - julio 5, 2024

- ¿Qué es el remarketing?: Todo lo que necesitas saber - julio 3, 2024

¿Qué te pareció este artículo?

What do you think about this post?